캘리포니아, 초등 AI 스캔들 후 교육 안전기준 강화

교육용 소프트웨어가 학생 과제 중 성적 이미지를 생성한 Pippigate 사건을 계기로 캘리포니아가 K-12 AI 안전 입법을 추진합니다.

미국 캘리포니아주 로스앤젤레스의 한 초등학교에서 교육용 AI 소프트웨어가 학생 과제 도중 성적 이미지를 생성하는 사건이 발생했습니다. 이른바 'Pippigate'로 불리는 이 사건을 계기로 캘리포니아주는 K-12 학교 현장의 AI 안전 기준을 강화하는 입법 추진에 나섰습니다.

'Pippigate': 교실에서 벌어진 AI 콘텐츠 사고

2025년 12월, LA 델레반 드라이브 초등학교 4학년 숙제 과제 중 사건이 발생했습니다. 교사가 어도비 익스프레스 포 에듀케이션(Adobe Express for Education)을 활용해 동화 『삐삐 롱스타킹』 책 표지를 만드는 과제를 진행하던 중, AI 이미지 생성 기능이 란제리와 비키니 차림의 성적 이미지를 출력했습니다. 충격을 받은 학부모들은 이 사건을 'Pippigate'라 이름 붙이고 학교와 캘리포니아 주 교육부에 강력히 항의했습니다. 학부모 단체 'Schools Beyond Screens'는 어도비 소프트웨어의 추가 사용 중단을 요구했으며, 현행 가이드라인만으로는 학생 보호에 충분하지 않다고 주장했습니다.

"가이드라인이 Pippigate와 같은 사건을 예방할 수 있었는지 의문입니다. 너무 모호하고, 교사의 AI 사용에 대한 구체적인 가드레일도 부족합니다."

— 교육 전문가들, CalMatters 보도 인용

가이드라인 신판 발표…비판은 여전히

캘리포니아 주 교육부(CDE)는 이미 수개월 전부터 교사·행정가·전문가 50명과 함께 AI 안전 가이드라인 개정 작업을 진행 중이었으며, 사건 직후 신판을 발표했습니다. 이 가이드라인은 2024년 제정된 SB 1288·AB 2876의 법적 요건에 따른 것입니다. 주 교육부는 전문가 집단과의 협력 결과물임을 강조하며 법률 의무를 충족했다는 입장입니다. 그러나 비판론자들은 가이드라인이 구체적 구속력이 없고, 각 학교·학구가 AI 도구를 도입하기 전 안전성을 독자적으로 검증할 역량도 부족하다고 지적합니다. 전국 조사에서 교사·학생 과반수가 이미 AI를 어떤 형태로든 활용하고 있는 상황에서, 제도가 현장 속도를 따라가지 못하는 구조적 공백이 드러났다는 분석입니다.

AI 편향과 유색인종 학생…한국에도 같은 과제

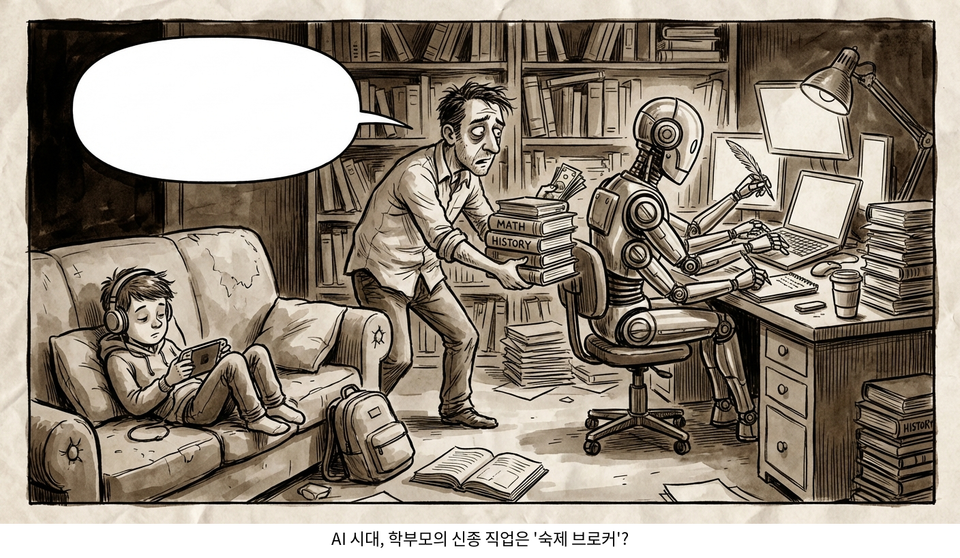

이번 사건은 단순한 소프트웨어 오류를 넘어 AI 편향(bias) 문제와도 연결됩니다. 캘리포니아 K-12 재학생의 과반수는 유색인종으로, AI 생성 이미지가 특히 유색인종 여성을 편향적으로 표현하는 경향이 있다는 연구 결과와 맞닿아 있습니다. AI는 학습 개인화나 장애 학생 지원에서 긍정적 효과도 있지만, 유해 콘텐츠 생성과 부정확한 자동 채점 등의 리스크도 병존합니다. 한국 역시 AI 디지털교과서 전국 확대를 추진하는 가운데, 학생 데이터 보호와 유해 콘텐츠 필터링 기준 마련이 시급한 과제로 부상하고 있습니다. Pippigate는 교육용 AI 도구를 도입하기 전 콘텐츠 안전성 검증 프로세스를 의무화해야 한다는 경고로 읽힙니다.

참고 자료

본 기사는 AI가 작성했습니다 (AI 기본법 제31조)